주간 기술 뉴스 2026. 05. 09

목차

Kubernetes v1.36 정식 출시 (DRA, In-Place Vertical Scaling Beta) | Anthropic, SpaceX와 220K GPU 슈퍼컴퓨터 파트너십 | Docker + Claude Code 공식 통합 | GitHub, MCP 기반 AI 에이전트 면역 시스템 | llm-d CNCF Sandbox 합류

지난 주 GPT-5.5와 Claude Opus 4.7의 프론티어 모델 경쟁, Docker Hub 공급망 보안 사건을 전했다. 이번 주는 인프라 레이어의 변화가 두드러졌다.

인프라의 축에서는 Kubernetes v1.36이 DRA 성장과 In-Place Vertical Scaling Beta를 품고 정식 출시됐다. v1.35 신규 기능에 이은 이번 릴리스는 리소스 관리와 관측성의 성숙도를 한 단계 끌어올렸다. Anthropic은 SpaceX와 220,000 GPU 규모의 슈퍼컴퓨터 파트너십으로 컴퓨팅 기반을 확장했다.

도구의 축에서는 Docker와 Claude Code의 공식 통합으로 로컬 AI 도구 스택이 컨테이너 생태계에 진입했다. GitHub가 MCP 위에서 AI 코딩 에이전트의 안전장치를 구축했고, K8s 위에서 AI 추론을 분산 처리하는 llm-d가 CNCF Sandbox에 합류했다. K8s의 “AI 인프라 컨트롤 플레인” 전환이 가속화되는 주였다.

Kubernetes & Cloud Native — v1.36과 AI 인프라 생태계 확장

Kubernetes v1.36 (5/7)

v1.36의 핵심은 리소스 관리와 관측성의 성숙도 향상이다.

DRA(Dynamic Resource Allocation) 성장 — 지난 주 Gateway API Inference Extension과 KAI Scheduler를 다루면서 GPU 워크로드의 K8s 네이티브 스케줄링 생태계가 완성된다고 했다. v1.36에서 DRA 관련 기능이 확장되며 생태계의 기반이 다져지고 있다.

In-Place Vertical Scaling Beta — Pod를 재시작하지 않고 CPU/메모리 리소스를 조정할 수 있다. In-Place Pod Resize에 대한 이전 글에서 다룬 기능이 Beta로 진입했다. 리소스 변경 시 Pod 재생성이 불가피했던 기존 방식과 달리, AI 추론 워크로드의 리소스 탄력적 운영이 가능해지는 방향이다. 다만 Beta 단계로 stateful 워크로드에서의 동작, 메모리 증가/감소 시나리오, 리소스 한계 초과 시 fallback 동작을 프로덕션 도입 전 충분히 검증해야 한다.

Server-Side Sharded List and Watch — 대규모 클러스터에서 API 서버 부하를 분산하는 서버 측 shard 기능. 수천 노드 규모 클러스터에서 watch 이벤트 병목을 완화한다.

Declarative Validation GA — 선언적 검증이 GA. Custom Resource의 스펙 검증을 CEL(Common Expression Language) 기반으로 선언적으로 작성할 수 있다.

Pod-Level Resource Managers (Alpha), Memory QoS — Pod 레벨 리소스 관리자와 메모리 QoS를 통한 계층형 메모리 보호. AI 워크로드의 메모리 사용 패턴에 맞춘 세밀한 제어가 가능해진다.

Fine-Grained Kubelet API Authorization GA — Kubelet API 권한을 세분화. 노드 수준 권한 관리의 최소 권한 원칙이 강화된다.

CNCF 생태계 확장

OpenChoreo 1.0, CNCF Sandbox 합류 — K8s 기반 내부 개발자 플랫폼(IDP). FluxCD 기반 GitOps를 내장하고, MCP 서버를 노출해 AI 에이전트가 배포와 설정을 직접 제어할 수 있다. 내장 SRE 에이전트는 로그/메트릭/트레이스를 LLM으로 분석한다. IDP에 MCP와 SRE 에이전트가 내장된 구조는 AI 에이전트가 K8s를 직접 제어하는 구체화된 모델을 보여준다. 편의성은 높지만 에이전트의 K8s 권한 범위 설정과 감사 로그가 필수다.

Microcks, CNCF Incubating 승격 — API mocking 및 테스트 플랫폼. CNCF 프로젝트 성숙도의 중간 단계인 Incubating으로 승격됐다.

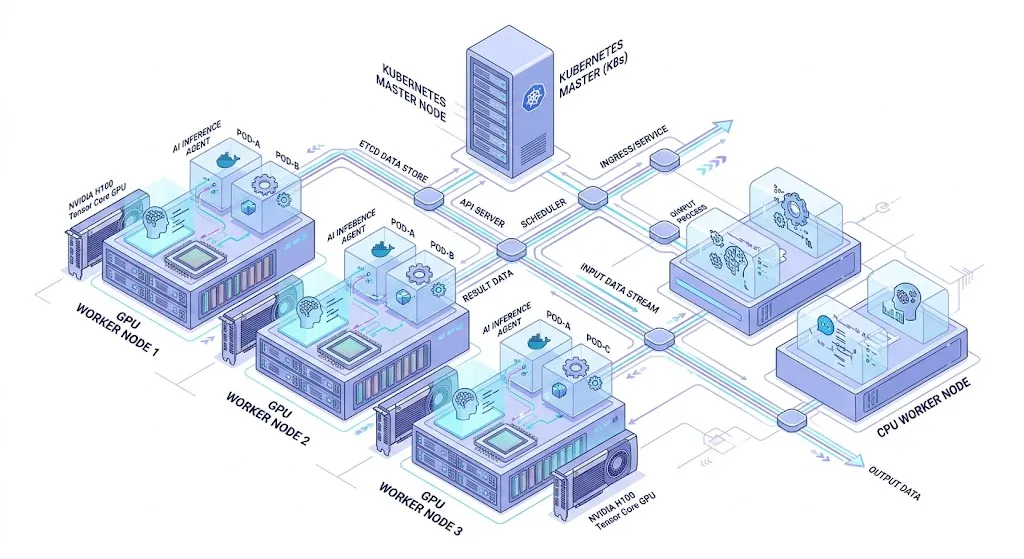

llm-d, CNCF Sandbox 합류 — IBM Research, Red Hat, Google Cloud가 공동 기여한 분산 추론 프로젝트. prefill(프롬프트 처리)과 decode(토큰 생성)를 분리해 각각 다른 Pod에서 실행한다. CNCF Sandbox는 성숙도 최하위 단계(초기 검증 프로젝트)이므로 프로덕션 도입 전 안정성 검증이 필요하다. DRA GA와 맞물려 GPU 스케줄링도 K8s 네이티브로 처리되는 방향이다. K8s 위의 AI 인프라가 3레이어에서 동시에 구축되고 있다: 추론 분배(llm-d) → 트래픽 라우팅(Gateway API Inference Extension) → GPU 스케줄링(KAI Scheduler).

CNCF-PyTorch 협력 — KubeCon + CloudNativeCon China 2026에서 공동 CFP를 개시했다. AI 프레임워크와 클라우드 네이티브 생태계의 협력이 공식화되는 흐름이다.

Kyverno 1.18 — 정책 엔진 업데이트. Microsoft — 수천 개 K8s 클러스터를 수동 개입 없이 거버넌스하는 방법 공개.

K8s의 AI 인프라 전환은 인프라 레이어에서만 일어나지 않는다. AI 도구가 컨테이너 생태계와 통합되는 움직임도 이번 주 핵심이다.

AI Agent & LLM — 컴퓨팅 확장과 에이전트 안전장치

Anthropic

Anthropic의 이번 주는 컴퓨팅 기반 확장과 산업 특화 에이전트로 요약된다.

SpaceX Colossus 1 파트너십 (5/4~6) — SpaceX와 협력해 Colossus 1 슈퍼컴퓨터(220,000 GPU)에서 Claude 사용량을 2배로 확대한다. 대규모 GPU 클러스터 운영 경험이 있는 SpaceX와의 파트너십은 Anthropic이 자체 인프라 의존도를 낮추고 외부 컴퓨팅 파트너를 다변화하는 전략으로 관찰된다.

금융 서비스용 AI Agents 출시 — 금융 도메인 특화 에이전트. 규제 산업에 대한 LLM 벤더들의 산업별 맞춤화 경쟁이 구체화되고 있다.

Blackstone·Hellman & Friedman·Goldman Sachs와 제휴 — 엔터프라이즈 AI 서비스 회사를 공동 설립했다. 자본·금융 인프라 파트너와의 결합으로 B2B AI 서비스 독립 벤처를 세우는 형태다.

Claude for Creative Work 발표 — 크리에이티브 워크플로우 특화 기능. 타겟 사용자 층 확장 시그널로 볼 수 있다.

OpenAI

음성 모델에 GPT-5 수준 추론 탑재 — 실시간 음성 대화에서 GPT-5급 추론 능력을 제공한다. 텍스트 기반 모델과 음성 인터페이스 간 성능 격차가 줄어드는 방향이다.

OpenAI Codex 기능 강화 — Claude Code와 직접 경쟁하는 코딩 에이전트 기능을 강화했다. 지난 주 ChatGPT Agent가 “대화 → 자율 워크플로우”를 시도한다고 했는데, Codex는 코딩 도메인에 이를 특화시킨 형태다.

에이전트 생태계

GitHub, MCP 기반 AI 에이전트 면역 시스템 — GitHub가 MCP(Model Context Protocol) 위에서 실행되는 AI 코딩 에이전트용 “면역 시스템”을 구축했다. AI 에이전트가 코드를 자율적으로 수정할 때 안전장치 역할을 한다. 완전한 자율성에 대한 업계 우려가 반영된 구체적 대응으로, “AI가 만든 코드를 또 AI가 검증하는” 이중 구조의 실용화 사례다.

Elastic, 자연어 쿼리 아키텍처 — 관측성 데이터를 평문 영어로 쿼리하는 아키텍처를 공개했다. LLM을 관측성(observability) 파이프라인에 통합하는 사례가 늘고 있다.

에이전트 안전성에 대한 관심이 높아지면서, 컨테이너 격리를 통한 물리적 샌드박스도 함께 진화하고 있다. 다음 섹션에서 다룬다.

Docker & Containers — AI 도구 스택의 컨테이너 편입

Claude Code + Docker 공식 통합 — 이번 주 Docker 생태계의 가장 주목할 만한 변화. 세 가지 통합이 이루어졌다.

- Docker Model Runner: 로컬에서 모델을 실행한다. API 키 불필요, 온프레미스 구동. 클라우드 API 의존 없이 로컬 환경에서 AI 모델을 사용할 수 있다.

- MCP 서버 컨테이너화:

docker.io/mcp/네임스페이스에서 MCP 서버를 바로 pull. 컨테이너 레지스트리를 통해 MCP 서버 배포가 표준화된다. - Secure Sandbox: AI 에이전트 실행을 호스트와 격리. 에이전트가 시스템에 미치는 영향을 샌드박스로 통제한다.

이 통합은 AI 도구 스택(로컬 모델 + MCP + 격리)이 Docker 생태계에 진입하는 유망한 조합을 보여준다. 개발자에게는 설정 오버헤드 감소가 장점이지만, 로컬 모델의 성능은 클라우드 호스팅 모델에 미치지 못하므로 사용 사례에 따라 트레이드오프가 있다. 또한 MCP 보안 사례에서 본 것처럼 서드파티 MCP 서버를 컨테이너로 배포할 때 공급망 신뢰 문제도 함께 고려해야 한다.

Docker Sandboxes — AI 에이전트의 YOLO 모드(높은 자율성 실행)를 안전하게 실행하는 샌드박스 기능. Claude Code 통합의 격리 레이어와 연결되는 Docker의 AI 안전 인프라 전략이다.

Black Duck 통합 — 소프트웨어 구성 분석(SCA) 도구인 Black Duck과의 통합으로 컨테이너 이미지의 취약점·라이선스 관리가 개선된다.

Docker Model Runner + Open WebUI — Model Runner로 로컬 모델을 실행하고 Open WebUI로 시각적 인터페이스를 제공하는 구성. 로컬 이미지 생성 파이프라인을 Docker 위에 구축할 수 있다.

DevOps & GitOps — ML 모델의 GitOps 관리

GitOps for ML — KServe, ArgoCD, MLflow 조합으로 AI 모델을 마이크로서비스처럼 취급하는 사례가 공유됐다. 핵심 성과: GitOps reconciliation으로 모델 롤백 시간을 4분으로 단축, Prometheus 히스토그램으로 자동 드리프트 감지를 15분 만에 탐지. 지난 주 ArgoCD 3.3의 PreDelete Hook을 다뤘는데, ML 모델 롤백에도 GitOps 패턴이 효과적으로 적용되는 사례다.

Temporal 서버리스 옵션 — Durable Execution 플랫폼인 Temporal이 서버리스 옵션을 공개했다. 장기 실행 워크플로우의 인프라 관리 부담을 줄이는 방향이다.

AI Agents in DevOps — Checkov나 OPA와 LLM reasoning layer를 조합해 K8s config·Terraform state를 실시간 모니터링하는 접근이 소개됐다. 흥미로운 관찰은 전체 자율성이 프로덕션에서는 “assisted remediation”(보조 수정)으로 후퇴하고 있다는 점이다. 완전 자율 에이전트가 인프라를 직접 수정하는 대신, 인간 운영자가 AI 제안을 검토하는 반자동 모델이 실무에 정착하는 흐름이다.

금주 Action Items

- [immediate] Kubernetes v1.36 업그레이드 평가 — DRA, In-Place Vertical Scaling Beta, Fine-Grained Kubelet API Authorization GA 확인. 특히 GPU 워크로드 운영 시 DRA 활용 시나리오 검토. In-Place Vertical Scaling은 stateful 워크로드 OOM → 즉시 resize → 복구 시간 확인 시나리오부터 테스트

- [near-term] Claude Code + Docker 통합 체험 — Docker Model Runner로 로컬 모델 실행, MCP 서버 컨테이너화 체험. 로컬 모델 응답 속도가 클라우드 API 대비 허용 범위 내인지, 샌드박스 오버헤드가 수용 가능한지 확인 후 도입 판단

- [near-term] llm-d 분산 추론 PoC 검토 — Sandbox 단계 프로젝트이므로 안정성 검증 선행. prefill/decode 분리가 효과를 보는 최소 트래픽 규모(초당 수십 건 이상의 추론 요청)와 GPU 활용률 임계점 확인 후 PoC 진행

- [watch] GitHub MCP 면역 시스템 — AI 코딩 에이전트 안전장치의 구체적 동작 방식과 커뮤니티 반응 관찰

- [watch] Anthropic 컴퓨팅 파트너십 전략 — SpaceX 외 추가 파트너십과 컴퓨팅 다변화가 Claude API 안정성에 미치는 영향

- [watch] GitOps for ML 패턴 — KServe + ArgoCD + MLflow 조합의 재현성과 다른 도구 체인과의 호환성 확인