주간 기술 뉴스 2026. 04. 04

목차

K8s v1.36 릴리스 예고 (4/22) | Kyverno CNCF Graduated | NVIDIA GPU DRA + KAI Scheduler CNCF 기증 | llm-d Sandbox 합류 | Docker Hardened Images 1,000+ 오픈소스 공개

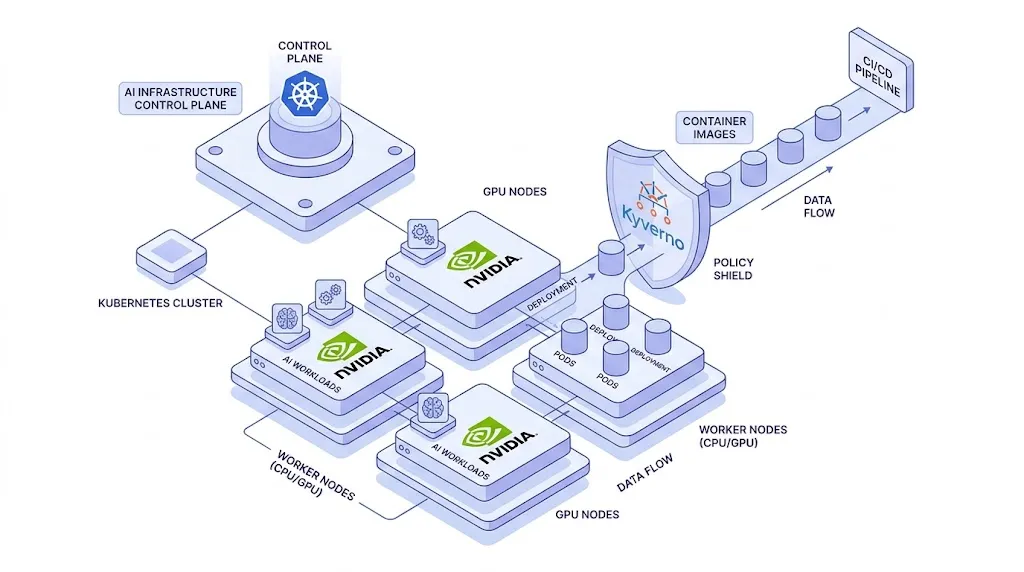

K8s가 AI 인프라의 표준 컨트롤 플레인으로 수렴하고 있다. 지난 주 KubeCon EU 2026 현장에서 Dapr Agents v1.0 GA, HolmesGPT Sandbox 합류를 전한 바 있는데, 이번 주는 그 흐름이 더욱 구체화되었다. K8s v1.36 릴리스 예고와 함께 NVIDIA가 GPU DRA 드라이버와 KAI Scheduler를 CNCF에 기증하고, Kyverno가 Graduated에 도달하면서 GPU 스케줄링부터 정책 거버넌스까지 K8s 위에서 표준화되는 그림이 선명해졌다. 물론 모든 AI 워크로드가 K8s 위에서 돌아야 한다는 의미는 아니다 — 서버리스 추론이나 전용 GPU 팜이 더 적합한 경우도 여전히 많다. 한편 한국에서는 세계 최초의 국가 수준 AI 규제인 AI기본법이 오늘부터 시행되었다.

Kubernetes v1.36: In-Place Pod Resize 베타 승격과 80개 개선사항

Kubernetes v1.36이 4월 22일 릴리스 예정이다. 80개 개선사항이 포함되며, 주목할 변경사항은 다음과 같다.

In-Place Pod Resize 베타 승격 — 이전에 상세히 다룬 서비스 중단 없이 실행 중인 Pod의 CPU/메모리를 조정하는 기능이 베타로 올라갔다. v1.35에서 알파로 도입된 이후 빠르게 안정화되고 있으며, AI 추론 워크로드처럼 부하 변동이 큰 환경에서 특히 유용하다.

DRA Pod-Level Metrics GA — Dynamic Resource Allocation의 Pod 레벨 메트릭이 정식 출시되었다. AI/ML 워크로드에서 GPU 같은 확장 리소스의 실사용량을 Pod 단위로 정확히 추적할 수 있어, 과금 정산과 성능 분석에 직접 활용된다.

ServiceAccount 외부 서명 GA — ServiceAccount 토큰 서명에 외부 KMS나 HSM을 연동할 수 있는 기능이 GA에 도달했다. 규제 산업에서 요구하는 키 관리 정책과의 통합이 가능해진다.

externalIPs 디프리케이션 — CVE-2020-8554 대응으로 externalIPs가 디프리케이션 경로에 들어섰다. 오래된 보안 취약점이지만 하위 호환성 때문에 미뤄져 왔던 결정이 드디어 실행 단계에 진입했다.

CNCF 연간 조사에 따르면 K8s 프로덕션 사용률이 82%에 달하며, AI 추론 워크로드를 K8s로 관리하는 조직이 66%에 이른다. 2026년 말까지 추론이 훈련 대비 컴퓨팅 비중을 역전할 것으로 전망된다. 다만 이 수치는 대규모 조직 중심의 설문 결과이며, 중소 규모 팀에서는 K8s의 운영 복잡성과 전문 인력 요구가 여전히 진입 장벽으로 작용한다.

Kyverno CNCF Graduated: 정책 엔진의 에이전트 시대 확장

Kyverno가 3월 24일 CNCF Graduated에 도달했다. K8s 네이티브 정책 엔진으로, OPA/Gatekeeper와 달리 Rego 대신 YAML과 CEL 기반으로 정책을 작성할 수 있어 진입장벽이 낮다. Bloomberg, Coinbase, Spotify 등이 프로덕션에서 사용하고 있다.

주목할 점은 Kyverno가 AI/MCP 게이트웨이 정책 확장을 예고했다는 것이다. K8s 리소스 정책을 넘어 에이전트 시대의 거버넌스 도구로 진화하려는 시도다. 지난 주 Dapr Agents v1.0 GA와 함께 읽으면, CNCF 생태계가 AI 에이전트의 실행(Dapr)과 통제(Kyverno) 양쪽에서 동시에 움직이고 있음을 볼 수 있다.

다만 Kyverno의 MCP 정책 지원은 아직 예고 단계이며, 구체적인 스펙이 공개되지 않았다. OPA/Gatekeeper가 이미 확보한 대규모 정책 라이브러리 생태계와 비교하면, 새로운 영역에서의 실질적 경쟁력은 지켜봐야 한다. Graduated 달성이 기존 K8s 정책 영역에서의 검증이지, AI/MCP 확장의 검증은 아니라는 점을 구분할 필요가 있다.

NVIDIA CNCF 기증 가속: GPU DRA 드라이버와 KAI Scheduler

벤더들이 자사 핵심 기술을 커뮤니티에 기증하는 이유는 분명하다 — 표준이 되면 생태계가 커지고, 생태계가 커지면 자사 하드웨어 수요도 커진다. NVIDIA의 이번 주 두 가지 움직임도 이 맥락에서 읽힌다.

GPU DRA 드라이버 CNCF 기증 — NVIDIA가 GPU Dynamic Resource Allocation 드라이버를 커뮤니티 소유로 전환했다. AWS, Google, Microsoft, Red Hat 등이 참여하며, 기존 device-plugin에서 DRA로의 GPU 스케줄링 표준화가 본격화된다. v1.36의 DRA Pod-Level Metrics GA와 맞물려, GPU 리소스 관리의 표준 경로가 명확해지고 있다.

KAI Scheduler CNCF Sandbox 합류 — NVIDIA Run:ai 기반의 오픈소스 GPU 스케줄러다. 수천 노드 스케일에서 AI 워크로드의 토폴로지 인식 배치를 지원하며, DRA + 배치 스케줄링 + KubeRay 네이티브 통합을 제공한다. Sandbox 단계이므로 API가 자주 변경될 수 있고, 상용 지원이나 장기 LTS 보장은 아직 없다.

이전에 다룬 K8s v1.35의 DRA 개선사항과 연결하면, GPU 리소스 관리가 벤더 종속에서 커뮤니티 표준으로 전환되는 흐름을 확인할 수 있다. 다만 GPU 하드웨어 자체의 높은 초기 투자 비용과 운영 비용은 별개 문제이며, DRA 표준화가 이 비용 구조를 바꾸지는 않는다.

llm-d와 K8s Agent Sandbox: AI 추론과 에이전트의 K8s 네이티브화

llm-d CNCF Sandbox 합류 — IBM, Red Hat, Google이 기증한 K8s 네이티브 분산 LLM 추론 프레임워크다. vLLM 기반으로 prefill/decode 분리 스케일링을 지원하며, GPU뿐 아니라 TPU, AMD, Intel 등 멀티 가속기를 지원한다. 특정 벤더의 GPU에 종속되지 않으면서 K8s 위에서 LLM 추론을 표준화하려는 시도다. 다만 Sandbox 초기 단계로, 프로덕션 레퍼런스가 부족하고 API 안정성이 보장되지 않으며, 문서화도 아직 충분하지 않다. 프로젝트 방향이 변경되거나 중단될 가능성도 염두에 둬야 한다.

K8s Agent Sandbox 프리미티브 — SIG-Apps에서 에이전트 워크로드를 위한 Sandbox 프리미티브를 표준화하고 있다. 보안 격리, 지연 최소화를 위한 Warm Pool, 비용 절감을 위한 PVC 하이버네이션 등이 포함된다. 지난 주의 Dapr Agents, HolmesGPT와 같은 맥락에서 CNCF가 에이전트 인프라 전체를 포괄하려는 방향성이 보인다.

llm-d + KAI Scheduler + Agent Sandbox를 조합하면, GPU 스케줄링부터 추론 서빙, 에이전트 격리까지 K8s 위에서 구성할 수 있는 청사진이 그려진다. 단, 이것은 각 프로젝트가 성숙했을 때의 비전이다. 현재는 Graduated(Kyverno), Sandbox(llm-d, KAI Scheduler), 표준화 진행 중(Agent Sandbox)으로 성숙도가 제각각이며, 프로덕션에서 이들을 조합해 운영하는 레퍼런스는 아직 없다.

멀티에이전트 시스템 성장세와 CI/CD 에이전트 대응

앞서 다룬 K8s 인프라가 성숙해야 그 위에서 에이전트가 안정적으로 운영될 수 있다. 그 에이전트 수요가 얼마나 되는지 수치로 확인해보자.

Gartner 멀티에이전트 문의 1,445% 급증 — Q1 2024 대비 Q2 2025 기준이다. Anthropic도 “멀티에이전트 조율”을 2026년 최우선 과제로 선정했다. 에이전틱 AI를 프로덕션에서 실행 중인 조직이 57.3%에 달하며, 추가 30.4%가 구체적 배포 계획을 갖고 있다.

다만 이 수치는 자기 보고(self-reported) 설문 기반이며, “프로덕션 실행”의 정의가 copilot 수준의 보조 도구 활용부터 완전 자율 에이전트까지 넓게 걸쳐 있다. 실무에서 이 수치를 도입 근거로 사용하기보다는, 자사 에이전트의 자율 운영 수준을 MTTR, 롤백률, 에이전트 개입 없는 완료율 같은 운영 지표로 측정하는 것이 더 의미 있다.

이 성장세는 DevOps에도 직접적 영향을 미치고 있다. 76%의 DevOps 팀이 이미 CI/CD에 AI를 통합했으며(2025년 기준), 자동 롤백, 자가 치유 인프라, 에이전트 기반 배포 결정이 표준화 추세다. 멀티에이전트 시스템이 코드를 생성하면서, merge 전략과 테스팅 프레임워크도 “에이전트가 만든 코드”를 다루는 방식으로 진화해야 한다. 다만 에이전트 생성 코드의 보안 검증, 라이선스 컴플라이언스, 책임 소재 등은 아직 업계 표준이 확립되지 않은 영역이다.

Docker Hardened Images 1,000+ 오픈소스 공개

Docker가 1,000개 이상의 보안 강화 컨테이너 이미지를 Apache 2.0 라이선스로 공개했다. CVE가 거의 제로에 가까우며, 완전한 SBOM과 SLSA Level 3 provenance를 제공한다. Debian과 Alpine 기반이다.

상용 보안 이미지 서비스(Chainguard 등)의 대안으로 활용할 수 있다. 특히 llm-d, KAI Scheduler 등 K8s 위 AI 추론 표준화와 맞물려, 컨테이너 기반 모델 서빙에서 보안 기준선을 높이는 데 기여할 것으로 보인다.

More: 디지털 인프라의 물리적 취약성

기술 뉴스 밖이지만 엔지니어가 인지해야 할 움직임이 있다. Project Maven은 미군의 AI 타깃 식별 시스템으로, Palantir 기반이다. 24시간 내 1,000개 타깃 식별이 가능하다고 알려져 있으며, 민간인 피해 우려와 의회 감독 요구가 증가하고 있다. 중동에서는 이란이 데이터센터 서버랙을 군사 타깃으로 삼은 최초 사례가 보고되면서, 디지털 인프라의 물리적 보안이 새로운 의제로 부상했다.

이번 주 실무 체크포인트

- 확인할 것: K8s v1.36 릴리스 노트 프리뷰(4/22 예정). In-Place Pod Resize 베타 승격으로

kubectl patch pod --subresource=resize워크플로우 검토 시점. externalIPs 사용 중이라면 대체 경로 계획 필요 - 시도할 것: Docker Hardened Images 카탈로그에서 현재 베이스 이미지 대체 가능 여부 비교. Kyverno CEL 정책 평가 시

kubectl apply -f한 줄로 시작할 수 있는 공식 예제 참고 - 지켜볼 것: NVIDIA GPU DRA 드라이버 커뮤니티 거버넌스 구조, llm-d + KAI Scheduler Sandbox 성숙도 (프로덕션 적용은 최소 6개월 이상 관망 권장)

- 규제 대응: 한국 AI기본법 시행(4/4). 고성능 AI 시스템에 안전성 요건 의무화. AI 모델 배포 파이프라인에 안전성 검증 단계 설계 필요 여부를 법무/컴플라이언스 팀과 확인